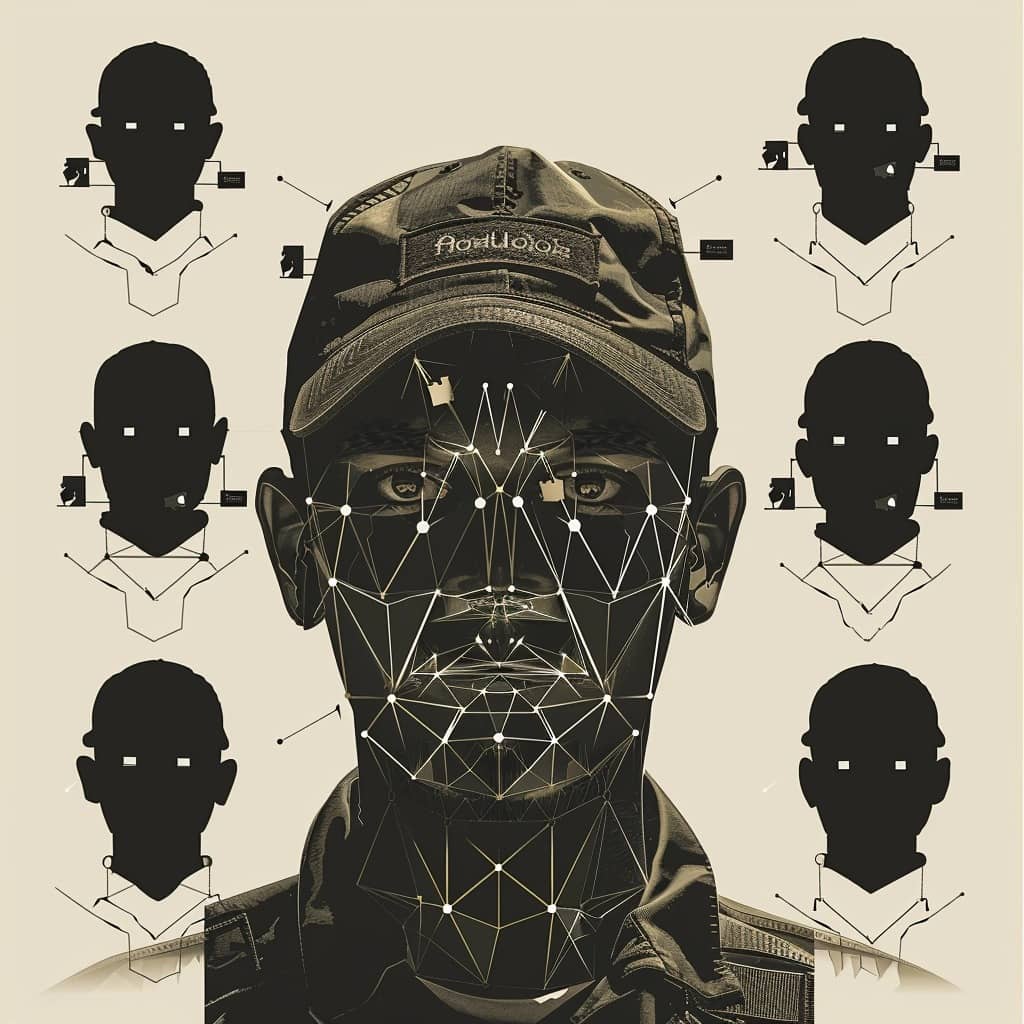

Технология распознавания лиц может быть мощным инструментом обеспечения безопасности, но также и опасным оружием, если используется непрозрачным и дискриминационным способом. Об этом свидетельствует то, что произошло в секторе Газа, где Израиль незаметно реализовал обширную программу биометрического наблюдения за палестинцами после зверских и варварских нападений 7 октября. Используя алгоритмы Google Фото и стартап КорсайтИзраильская армия профилировала тысячи людей без их согласия, что представляет собой тревожный случай этнического профилирования с помощью высоких технологий.

Большой Брат в Газе

История, сообщает газета «Нью-Йорк Таймс»имеет черты триллера-антиутопии. После терактов 7 октября подразделение 8200 израильской армии (главное разведывательное подразделение) начало выявлять потенциальных подозреваемых, анализируя изображения с камер наблюдения и видео, которые ХАМАС разместил в социальных сетях. В то же время солдаты допрашивали палестинских заключенных, чтобы идентифицировать людей из их общин, связанных с ХАМАС.

Благодаря этому материалу стартап Корсайт (которая может похвастаться системами, способными распознавать лица, даже если менее 50% из них видны) создала специальный инструмент распознавания лиц для израильских офицеров, работающих в секторе Газа. Чтобы еще больше пополнить базу данных и найти другие цели, военные установили контрольно-пропускные пункты, оснащенные биометрическими камерами, вдоль основных дорог, по которым палестинцы бежали на юг. Целью, как сообщил Times чиновник, было создание «расстрельного списка» участников терактов 7 октября. На практике файл «обычных подозреваемых» основан на алгоритмах и этническом профилировании. Высокотехнологичная охота, проводимая без ведома и согласия участников. Оруэлловский кошмар стал реальностью.

Израиль, ошибки и злоупотребления

Технология, как мы знаем, не является непогрешимой. Особенно, когда оно основано на зернистых изображениях или частично закрытых лицах. Именно поэтому Европа придерживается вполне осторожного подхода к распознаванию лиц. Сами израильские солдаты признались Times, что система Corsight не всегда точна. Иногда он ошибочно называл людей связанными с ХАМАС. Это случай палестинского поэта Мосаб Абу Тоха, которого забрали на израильском контрольно-пропускном пункте, когда он пытался уехать из Газы в Египет вместе со своей семьей в середине ноября. ИИ объявил его в розыск. Результат: двое суток задержания, избиения и допросы, а затем отправка обратно в Газу. Даже без объяснений.

Судьба, которая могла бы постигнуть неизвестно сколько еще невинных людей, названных потенциальными террористами только из-за их этнической принадлежности или места, где они живут. Риск, присущий системам распознавания лиц, которые могут усилить человеческие предрассудки, если не использовать их с осторожностью и прозрачностью.

Google, большое ухо

Но за этой программой наблюдения стоит не только Corsight. Солдаты рассказали Times, что израильская армия объединила технологию компании с другим, более доступным и, возможно, даже более мощным инструментом: Google Фото. Офицеры разведки загрузили базы данных об известных лицах на серверы Big G и использовали функцию поиска изображений для выявления дополнительных подозреваемых. Google Photos, как заметил солдат, способна распознавать лица даже по минимальным деталям, превосходя другие приложения, в том числе Corsight.

Короче говоря, гигант Маунтин-Вью, возможно, сам того не ведая, стал ключевым винтиком в израильской машине контроля над сектором Газа. Великое ухо, способное картографировать и шпионить за всем населением, нарушая его частную жизнь и права во имя национальной безопасности. Спорное и непрозрачное использование ИИ, которое в Газе сочетается с использованием другие передовые технологии, такие как роботы и дроныи поднимает вопросы об этической ответственности крупных технологических компаний.

Не только Израиль: темное лицо слежки

К сожалению, случай Газы не является единичным. Компания Корсайт, основанная В 2019 с инвестициями в 5 миллионов долларов канадского фонда Awz Ventures она специализируется на предоставлении решений по распознаванию лиц. Для многих реалий: правительств, правоохранительных органов и армий. в 2020Всего через год после своего создания компания похвасталась, что может распознавать лица в масках. Два года спустя, в 2023 году, объявила, что разрабатывает инструмент, способный реконструировать черты человека по его ДНК (мы говорили об этом здесь). в 2023сотрудничал с полицией Боготы в розыске подозреваемых в убийствах и кражах в общественном транспорте.

Растущий бизнес, подпитываемый риторикой страха и жаждой безопасности, но не без серых зон. Просто подумайте о высказываниях Аарон Ашкенази, управляющий партнер Awz Ventures, который в редакционной статье в «Джерузалем Пост» в октябре прошлого года он написал, что его фонд предоставляет Израилю «технологические инструменты, чтобы остановить этих злых террористов». Легко представить, что это за инструменты.

На стороне Большого Брата

В более общем смысле миссия Corsight и других подобных компаний, похоже, является миссией на службе глобального Большого Брата. Попытка сделать каждое лицо отслеживаемым, каталогизированным и доступным для наблюдения в мире, где анонимность — это роскошь, которую мы больше не можем себе позволить, а конфиденциальность — необязательная возможность, которую можно принести в жертву на алтарь обороны.

Поэтому неудивительно, что в последние месяцы некоторые больницы в Израиле также начали использовать алгоритмы Corsight для идентификации изуродованных пациентов, как сообщает Forbes. Очевидно, что это гуманитарное применение, но оно открывает путь к более сомнительному использованию этой инвазивной технологии. Риск, как показывают события в секторе Газа, заключается в том, что системы распознавания лиц станут инструментами угнетения и дискриминации в чужих руках. Что они превращают право на безопасность в предлог для нарушения других фундаментальных прав, начиная с права на анонимность или право на справедливое судебное разбирательство. Давайте внесем ясность: речь идет не о демонизации самого распознавания лиц, которое может иметь положительное применение в различных областях, от здравоохранения до безопасности. Но регулировать его использование ясным и демократическим способом, ограничивая его потенциальные искажения и злоупотребления.

Это сводит людей к пикселям и процентам, маркируя их на основе цвета кожи, черт лица или социального происхождения. Кошмар, который, безусловно, ставит под вопрос ответственность тех, кто разрабатывает и продает эти технологии, но, безусловно, и тех, кто их покупает и использует.