второй последний отчет ООН по гражданской войне в Ливии, в завершающемся году впервые была показана автономная система вооружения, робот-убийца, убивший кого-то. В будущем мы могли бы запомнить это как отправную точку новой гонки вооружений, которая может нам очень сильно навредить.

В последние дни (с 13 по 17 декабря) Ла Конвенция ООН о конкретных видах обычного оружия собирались по этой теме, как это происходит каждые пять лет. С 1983 года это собрание решило ограничить использование некоторых жестоких видов оружия, таких как противопехотные мины. На этот раз он обсудил возможный запрет на это автономное оружие. И пока не достигнуто согласие по их ограничению.

Возможно, это была катастрофическая ошибка.

Автономные системы вооружения — это роботы-убийцы. В этом посте вы всегда услышите, как я их так называю: роботы-убийцы. Потому что это то, что я есть. Системы с вооружением, которые могут функционировать в одиночку. Системы созданы для войны, чтобы убивать людей. Мировые правительства вкладывают значительные средства в эту тенденцию.

С другой стороны, очевидно, что гуманитарные организации (одна из них, «Остановите роботов-убийц», что вы здесь найдете) посвящены просьбам о правилах и запретах на разработку этого оружия. И они преуспевают. Если мы не ограничим использование автономного оружия, это кончится очень плохо. Подрывные технологии в этой области смогут дестабилизировать все военные стратегии, увеличивая риск упреждающих атак. В том числе химические, биологические, ядерные.

Учитывая темпы разработки роботов-убийц, только что завершившаяся встреча ООН, возможно, была один из последних случаев чтобы избежать новой гонки вооружений. Или последний.

Когда дело касается роботизированных систем-убийц, есть четыре опасности, которые кажутся очевидными любому.

Первая проблема роботов-убийц: идентификация.

ВСЕГДА автономное оружие сможет отличить враждебного солдата от ребенка с игрушечным пистолетом? Разница между единственной человеческой ошибкой (которая тоже возможна) и неправильной настройкой алгоритма может довести проблему до невероятных масштабов. Позвонил эксперт по автономному оружию Пол Шарре использует метафору: неисправный пулемет, который продолжает стрелять, даже когда вы убираете палец со спускового крючка. И стрелять, пока не закончатся патроны, потому что это всего лишь автомат. Он не знает, что делает ошибку.

Что бы кто ни говорил, у искусственного интеллекта пока нет своей морали(и, вероятно, у него этого никогда не будет, он никогда не сможет этому научиться).

Проблема не только в этом даже ИИ ошибается, например, когда он признает астму фактором что снижает риск пневмонии, или когда он идентифицирует цветных людей как горилла. Просто когда оно совершает ошибку, тот, кто его создал, не знает, почему он допустил ошибку, и не знает, как ее исправить. По этой причине я считаю невозможным, чтобы роботы-убийцы могли развиваться с учетом каких-либо «моральных» критериев.

Вторая проблема с роботами-убийцами: низкое распространение.

Вооруженные силы, разрабатывающие автономное оружие, предполагают, что смогут его сдерживать и контролировать. Слышали ли вы более глупую идею, чем эта? Если и есть чему-то, чему нас учит история оружейных технологий, так это распространению оружия. Также в этом случае это было очень предсказуемо.

То, что произошло в прошлом с «Кашинковым», автоматом, который стал настолько доступным, что попадает в руки любого, может повториться и с роботами-убийцами. Давление рынка может привести к созданию автономного оружия, которое будет эффективным, дешевым и практически невозможно остановить. Самое главное: широко распространено. В руках правительств, бешеных лошадей, организованной преступности или террористических группировок.

Возможно, это уже произошло. В Каргу-2, созданный турецким оборонным подрядчиком, представляет собой нечто среднее между дроном и бомбой. Он оснащен искусственным интеллектом для поиска и отслеживания целей. Это робот-убийца, который уже действовал автономно на театре гражданской войны в Ливии, нападая на людей.

Третья проблема роботов-убийц: распространение высоких технологий.

Если затем подумать о «высококлассных» рисках, мы придем к «Зениту». Страны могли бы соревноваться в разработке все более разрушительных версий автономного оружия, в том числе способного устанавливать химическое, биологическое, радиологическое и ядерное оружие . Моральная опасность роста смертности от огнестрельного оружия будет усиливаться за счет расширения использования оружия.

Конечно, у этих роботов-убийц наверняка будут дорогие. этические контролеры призван минимизировать сопутствующий ущерб, преследуя миф о «хирургической» атаке. Короче говоря, хорошие вещи только для общественного мнения. Правда в том, что автономное оружие изменит даже самый банальный анализ затрат и выгод, который вы проводите перед планированием войны. Они будут представлять собой кости смертельного риска, и их можно будет бросать с меньшим беспокойством.

Асимметричные войны, ведущиеся на земле странами, не имеющими конкурирующих технологий, станут более распространенными. Чрезвычайно распространенная нестабильность.

Четвертая и последняя проблема: законы войны

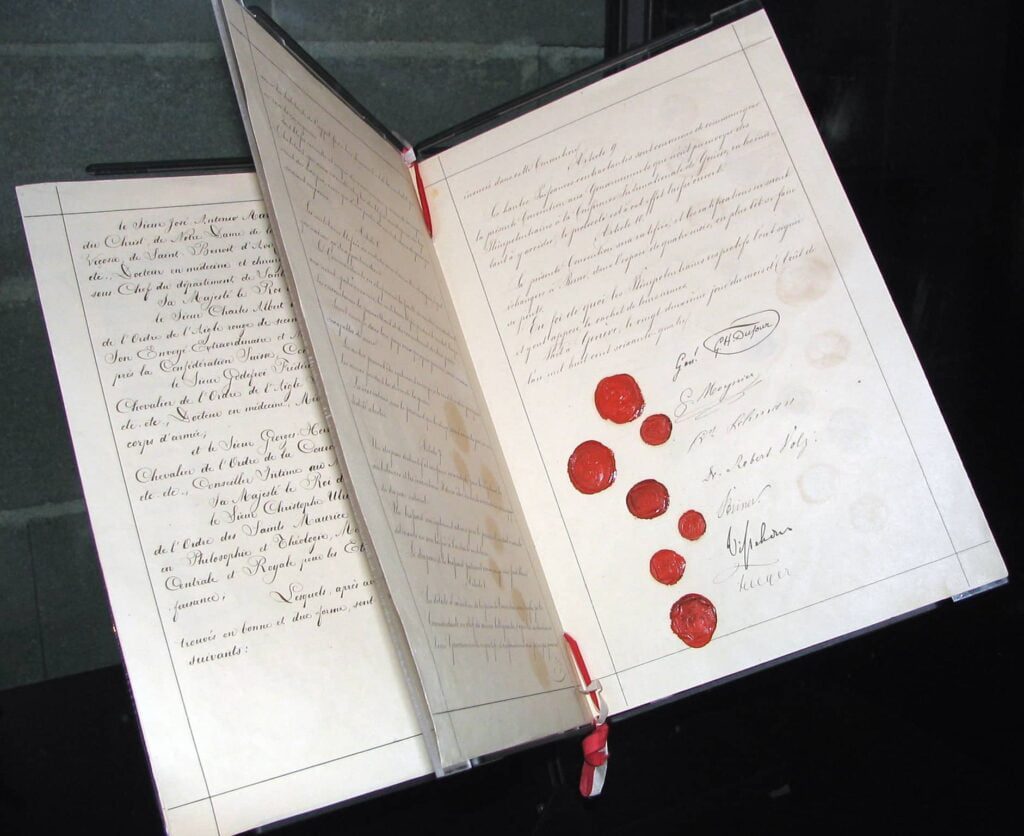

Роботы-убийцы (если они будут распространяться, это несомненно) подорвут последнее паллиатив человечества против военных преступлений и зверств: международные законы войны. Эти законы, кодифицированные в договорах, начиная с первых Женевская конвенция, они - тонкая грань, отделяющая войну от чего-то еще худшего, что я с трудом могу себе представить.

Законы войны имеют основополагающее значение, поскольку они также налагают ответственность на тех, кто ведет войну. Слободан Милошевич был президентом страны и должен был ответить за свои действия. Его судил Международный уголовный трибунал ООН по бывшей Югославии. он должен был ответить за то, что он сделал.

И сейчас? Виноват ли робот-убийца, совершающий военные преступления? Кого преследуют? Оружие? Солдат? Солдатские командиры? Компания, которая произвела оружие? Неправительственные организации и эксперты по международному праву опасаются, что автономное оружие приведет к серьезным последствиям. разрыв ответственности .

Нужно будет доказать, что военнослужащий совершил преступление с применением автономного оружия. Для этого необходимо будет доказать, что военнослужащий совершил виновное деяние, а также имел на это конкретное намерение. Довольно сложная динамика в мире роботов-убийц.

Мир роботов-убийц - это мир без правил, которые они налагают значительный человеческий контроль по оружию. Это мир, в котором будут совершаться военные преступления, и военные преступники не будут привлечены к ответственности. Структура законов войны вместе с их сдерживающим действием будет значительно ослаблена.

Новая глобальная гонка вооружений

Представьте себе, что каждый может использовать всю силу, которую он хочет, и когда хочет. С меньшими последствиями для всех. Представьте себе планету, где национальные и международные военные, повстанческие группы и террористы могут развернуть теоретически неограниченные смертоносные силы с теоретически нулевым риском в любое время и в любом месте по своему выбору, без какой-либо юридической ответственности.