В прошлом ноябре Мета Annunciato которая покончила бы с технологией маркировки распознавания лиц. Сегодня Microsoft также находится на том же уровне, стремясь успокоить клиентов. Он постепенно откажется от своего искусственного интеллекта распознавания лиц, который может обнаруживать эмоции (и многое другое).

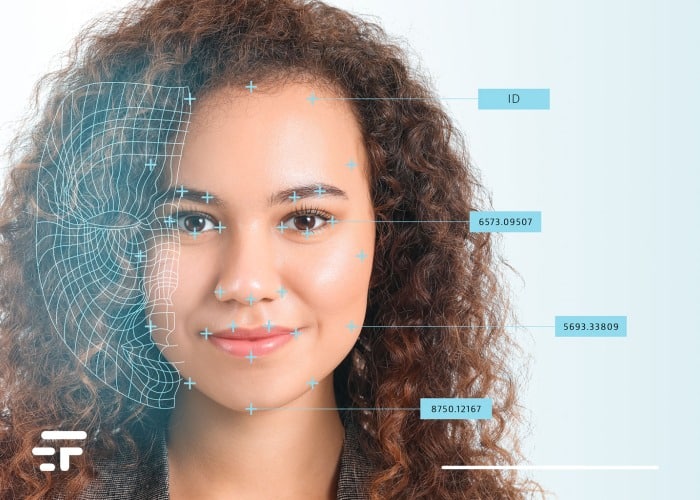

По данным портала Engadget эта технология просто не может определить, грустите вы, счастливы или злы. Благодаря своей способности точно идентифицировать такие характеристики, как возраст, пол и волосы, программное обеспечение искусственного интеллекта гиганта из Редмонда вызвало неизбежные (и законные) споры о конфиденциальности.

Долгое прощание

В сообщение в блоге от Microsoft, я читал, что новые пользователи фреймворка программирования Лицо Майкрософт они больше не смогут получить доступ к его функциям. А как насчет существующих клиентов? Спокойно: смогут опираться на технологии "только" до 30 июня 2023 г.

Это решение является частью плана Microsoft по разработке и распространению технологии искусственного интеллекта. Новая «более этичная» стратегия, которая обеспечит доступ к программному обеспечению для распознавания лиц только через собственные платформы Azure Face API, Computer Vision и Video Indexer.

Мы прекратим поддержку функций анализа лица, которые утверждают, что определяют эмоции и черты личности, такие как пол, возраст, улыбка, растительность на лице, прическа и макияж.

Из релиза Майкрософт

Вы звоните им, если хотите эмоций

Разумеется, вы можете себе представить: доступ к функциям с конфиденциальными атрибутами открывает широкие возможности для злоупотреблений. Отбор людей на основе этих параметров рискует подвергнуть их предубеждению, дискриминации или несправедливому отказу в услугах.

Когда ИИ станет более могущественным и прежде чем он станет разумным (что бы кто ни говорил это еще не так) требует внимания. Крупным компаниям пора предпринять шаги, чтобы гарантировать, что конфиденциальность и информация потребителей не будут скомпрометированы, а эта технология не будет использоваться в злонамеренных целях.